Pre godinu dana, AI agenti su jedva mogli da naprave landing page, a danas prave cele aplikacije. Šta se desilo? Ljudi imaju mišljenja.

Ben Hajlak, suosnivač i CTO Raindrop-a i bivši dizajner na Appleovom Human Interface timu, je jedan od njih. U svom blog postu "Accumulated Drift" koristi analogiju sa akcelerometrima, senzorima koji mere kretanje.

Akumulirana greška

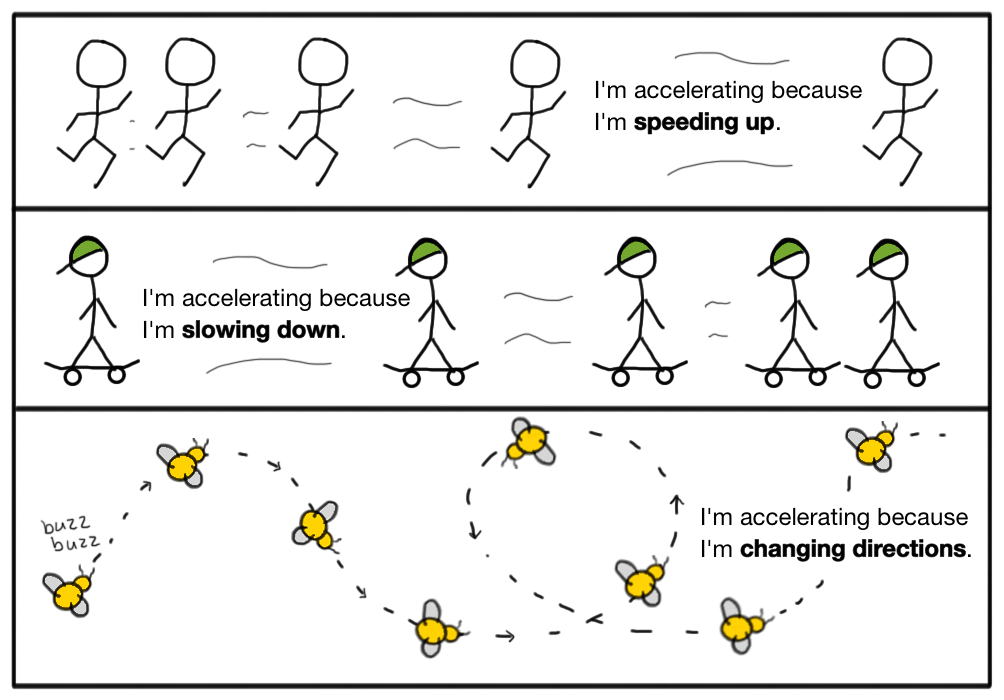

Akcelerometri imaju male greške u merenju, sitne i zanemarljive, ali problem nastaje kada te greške počneš da sabiraš. (Ilustracija Hajlakova.)

Recimo da praviš robota koji treba da se kreće po prostoriji. Svaki put kad proceni gde se nalazi, napravi malu grešku. Posle sat vremena, te male greške su se nakupile i robot misli da je u kuhinji dok zapravo udara u zid dnevne sobe.

Ista stvar se dešava sa AI agentima. Kada agent piše kod, svaki korak zavisi od prethodnog. Ako napravi malu grešku u prvom koraku, ta greška se prenosi u drugi. Drugi korak pravi svoju grešku, plus nosi grešku iz prvog, pa iz trećeg, i tako redom.

Zato su agenti pre godinu dana bili frustrirajuće nepouzdani. Mogli su da urade jedan ili dva koraka korektno, ali posle pet koraka sve bi krenulo naopako.

Zašto sada rade

Hajlak objašnjava da su se desile dve stvari. Modeli su prešli prag tačnosti: greška po koraku je pala sa otprilike 33% (jedan od tri koraka pogrešan) na oko 20% (jedan od pet). To ne zvuči kao velika razlika, ali kada greške kumuliraju kroz deset koraka, razlika je ogromna.

Sa 65% tačnosti po koraku, posle deset koraka imaš samo 1.3% šanse da je sve tačno. Sa 75%, ta šansa skače na 5.6%. Sa 90%, na 35%. (Ilustracija Anthropicova.)

Druga stvar je što su modeli dobili sposobnost da prepoznaju kada greše. Pre godinu dana, model bi nastavio da gradi na pogrešnoj osnovi. Danas, bolji modeli mogu da zastanu, provere šta su uradili, i isprave se pre nego što greška eskalira.

Kombinacija ove dve stvari, viša bazična tačnost plus sposobnost korekcije, prešla je tačku gde agenti postaju zaista korisni.

Gde pročitati više

Hajlakov originalni članak detaljnije objašnjava matematiku iza akumulirane greške i daje konkretne primere iz prakse. Ako buildujete sa AI agentima ili razmišljate o tome, vredi pogledati: "Accumulated Drift" na Substacku.