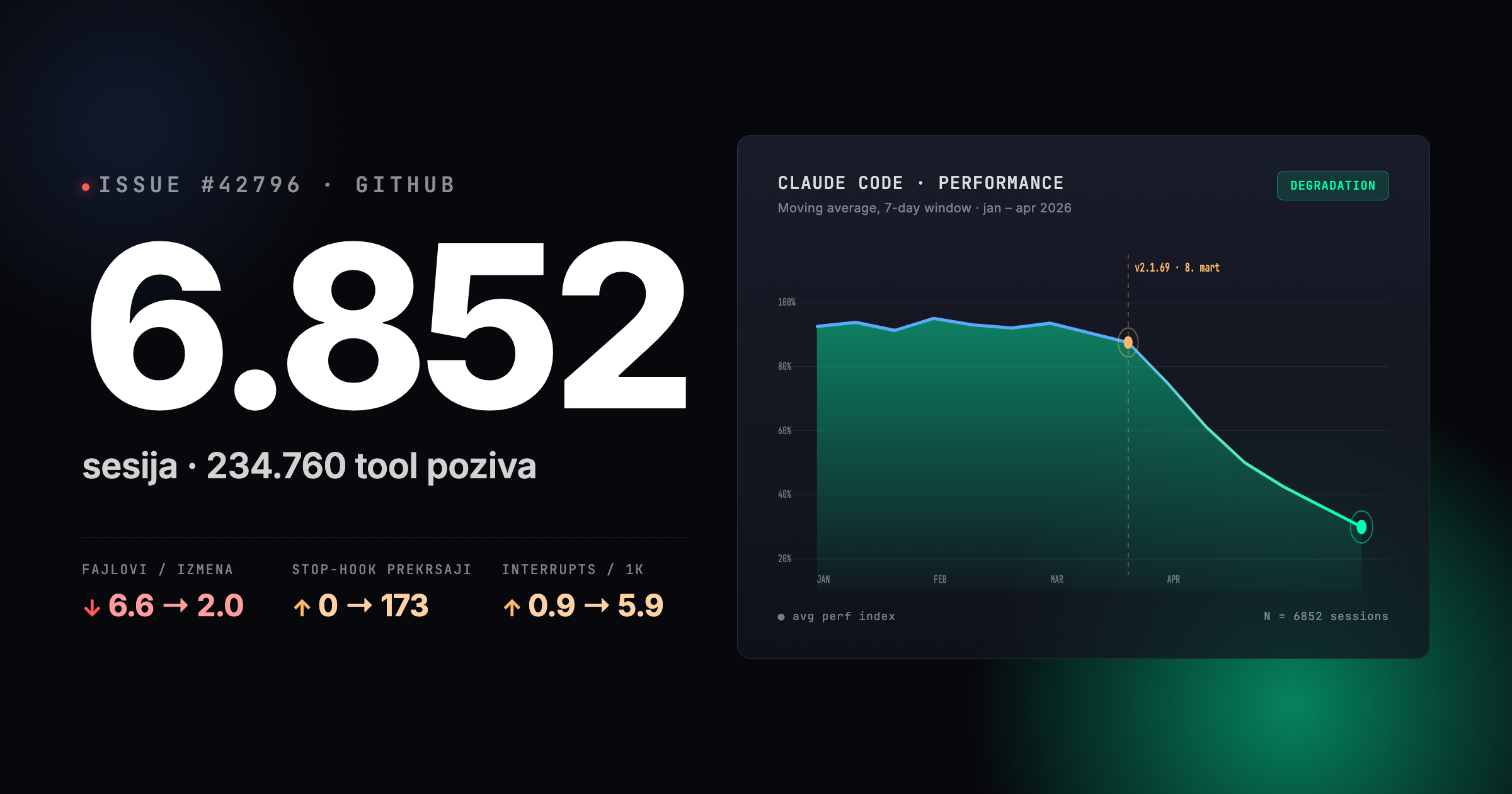

Reddit žalbe na to da je Claude Code "postao gluplji" dobile su prvi dokumentovan dataset. Stela Lorenco, Senior Director u AMD-ovoj AI grupi, otvorila je GitHub issue #42796 sa analizom 6.852 sesije i 234.760 tool poziva, tvrdeći da se Claude "toliko unazadio da mu se ne može verovati za složeni inženjerski rad".

The Register prenosi da je njen tim u AMD-u već prešao na drugog provajdera, a ime nisu otkrili zbog NDA. Issue je u međuvremenu eskalirao na X i postao najvidljivija žalba na kvalitet Claudea do sada.

Šta pokazuju brojevi

Prosečan broj pročitanih fajlova pre izmene pao je sa 6.6 na 2, pa se model sve češće baca na izmene bez prethodnog čitanja okolnog koda.

Stop-hook prekršaji, slučajevi kada model odustane pre nego što završi, skočili su sa nula pre 8. marta na 173 u narednim nedeljama, sa vrhom od 43 u jednom danu. Broj prekida od strane korisnika porastao je sa 0.9 na 5.9 po hiljadu tool poziva u istom periodu.

Lorenco tvrdi da je Anthropic tiho redukovao thinking tokene, pa model sada razmišlja pliće nego u januaru:

Kad je razmišljanje plitko, model bira najjeftiniju dostupnu akciju — izmenu bez čitanja, odustajanje pre završetka, najprostiju ispravku umesto ispravne.

Odgovor iz Anthropica

Boris Černi, koji vodi Claude Code, odgovorio je pinovanim komentarom u kom osporava glavnu tezu. Tvrdi da je header redact-thinking-2026-02-12 isključivo promena interfejsa koja skriva thinking blokove iz prikaza, ali ne dira dubinu razmišljanja ni thinking budžete.

Preporučuje opt-out preko showThinkingSummaries: true u settings.json. Anthropic zvanično nije odgovorio na pitanja The Registera.